苹果研究院质疑AI推理

苹果研究员Mehrdad Farajtabar等人发表的论文对大型语言模型(LLM)的推理能力提出质疑,认为LLM所谓的“推理”能力实际上只是复杂的模式匹配,并非真正的逻辑推理。

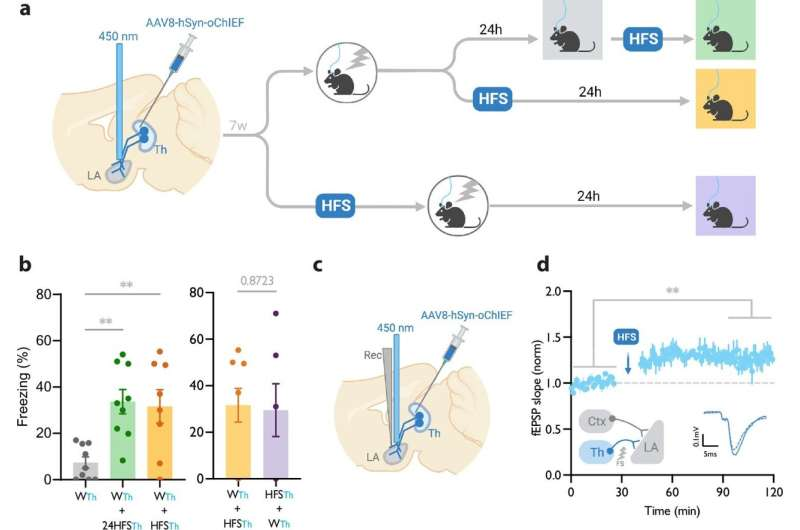

研究团队开发了GSM-Symbolic工具,基于GSM8K测试集生成符号模板,发现目前的LLM如Llama、Phi、Gemma、Mistral 等开源模型,以及 GPT-4o 和 o1 系列等闭源模型对专有名词和数字的更改非常敏感,显示出对数学概念理解的不足。

实验结果显示,即使在参数和数据量增加的情况下,LLM的推理能力并没有实质性提升,只是成为了“更好的模式匹配器”。

六名苹果 AI 研究员(其中一名是实习生)在预印本平台 arxiv 上发表了一篇论文《GSM-Symbolic: Understanding the Limitations of Mathematical Reasoning in Large Language Models》,他们发现大模型不能形式推理。研究人员称,GSM8K 基准测试被广泛用于评估大模型在小学水平问题上的数学推理能力。过去几年,大模型在 GSM8K 上的表现有显著提高,但它们的数学推理能力是否真的提升了?

研究人员利用符号模板创建了一个改进基准测试 GSM-Symbolic,能对大模型的推理能力进行更可控的评估。结果显示,大模型并不具有真正的逻辑推理能力,仅仅改变问题的某个数值或者增加一条子句,大模型的表现就会显著下降。

原文:https://arxiv.org/pdf/2410.05229

Meta 研究员认为大模型比猫还蠢

Meta 高级研究员、纽约大学教授 Yann LeCun 认为有关 AI 威胁人类的担忧都是一派胡言。他喜欢用猫打比方,猫科动物拥有物理世界的心理模型、持久记忆、有限的推理能力和规划能力。而这一切最先进的大模型并不拥有。Yann LeCun 于 2018 年因在深度学习上的贡献而与 Yoshua Bengio 和 Geoffrey Hinton 一起获得图灵奖,其中 Geoffrey Hinton 还在今年获得了诺贝尔奖。LeCun 认为 AI 是一种强大的工具,但今天的 AI 在任何意义上都称不上智能。然而科技行业的许多人,尤其是 AI 创业公司,正在以荒诞的方式轻信预测其近期的进展。他认为创造通用 AI 可能需要几十年的时间,而今天的主流方法无法让我们实现这一目标。大模型只是在预测文本的下一个单词,受益于其巨大的记忆容量,它们似乎在进行推理,但实际只是机械重复已经训练的信息。

男子通过苹果 AI 的短信总结获悉分手的消息

纽约程序员 Nick Spreen 周三通过 iPhone 15 Pro AI 功能 Apple Intelligence 测试版提供的短信总结功能获悉了分手的消息。

他在社交媒体上分享了这一消息,AI 总结了他女友发来的多条短信,宣布了分手的消息表示想要从公寓里拿回属于自己的物品。

苹果是在今年 6 月宣布了 Apple Intelligence,目前正在进行公测。

Spreen 在自己的 iPhone 手机上运行了测试版。它类似于一个精简版的 ChatGPT,通过读取用户收到的短信提供一个总结版本。

Adobe 开始推出生成式人工智能视频工具

当地时间14日,Adobe 表示已经开始公开发布一种可以根据文本提示生成视频的人工智能模型,加入了越来越多试图利用生成人工智能颠覆影视制作的公司行列。这项技术被称为 Firefly 视频模型,将与 OpenAI于今年早些时候推出的 Sora 展开竞争。

Adobe 将开始向已加入等候名单的用户开放该工具,但并未透露具体发布日期。Adobe 公司表示其视频编辑软件 Premiere 中集成了一项功能,让用户能够使用生成式人工智能来扩展视频片段。

其他可在线获取的工具让用户能够根据文本提示和现有图像制作视频。

本文中的原文链接都在视频下方的描述栏,

谢谢观看本视频。要是喜欢,请订阅、点赞。谢谢

油管:https://youtu.be/wNCoZ9hVL0s