它可以根据文字描述来生成视频。但它不是基于扩散模型,而本身就是个LLM,可以理解和处理多模态信息,并将它们融合到视频生成过程中。 不仅能生成视频,还能给视频加上风格化的效果,还可修复和扩展视频,甚至从视频中生成音频。 一条龙服务... 例如,VideoPoet...

作者: Tarogo Cloud

OpenAI推出的一音乐生成模型:Jukebox

OpenAI在2019年8月份就推出了他们的一音乐生成模型:Jukebox Jukebox能够根据提供的歌词、艺术家和流派信息生成多种流派和艺术家风格的完整音乐和人声歌曲。 最牛P的是,3年前的质量就已经这样了... 而且据说Jukebox 2即将发布

Groq 最近的硬件突破疯传

Groq(不是 Grok)使用 LPU 而不是 GPU,允许聊天机器人以几乎瞬时的响应时间运行 LLMs。 这开启了一个充满潜在人工智能和用户体验的全新世界。

OOTDiffusion:一个高度可控的虚拟服装试穿开源工具

可以根据不同性别和体型自动调整,和模特非常贴合。也可以根据自己的需求和偏好调整试穿效果 OOTDiffusion支持半身模型和全身模型两种模式。

AnyGPT:任意模态到任意多模态的大语言模型

通过连接大语言模型与多模态适配器和扩散解码器,AnyGPT实现了对各种模态输入的理解和能够在任意模态中生成输出的能力。 也就是可以处理任何组合的模态输入(如文本、图像、视频、音频),并生成任何模态的输出... 实现了真正的多模态通信能力。 这个项目之前叫NExT-GPT

PixelPlayer:MIT研究团队开发的项目

能自动从视频中识别和分离出不同的声音源,并与画面位置匹配。 例如,它可以识别出视频中哪个人物正在说话或哪个乐器正在被演奏。 而且还能够分别提取和分离这些声音源的声音。 PixelPlayer能自我学习分析,无需人工标注数据。...

利用Groq可以实现实时AI对话

将运行在 Groq 上的 Llama-70B 模型与 Whisper 模型结合,实现了几乎零延迟的性能。 如果在GPT 4或者未来更高版本GPT 5能实现这速度,想象空间很大,几乎秒级就能写一本书出来,AI实时通话都不是问题!

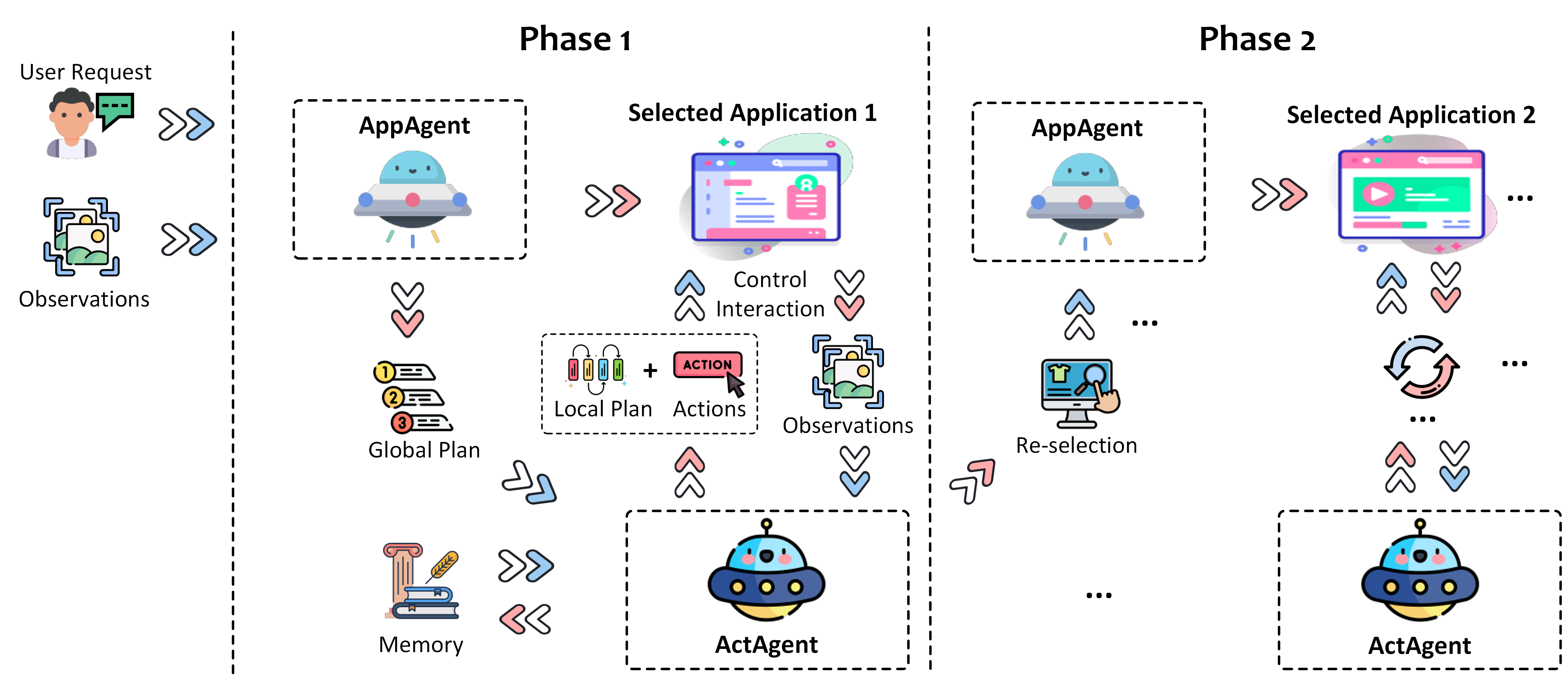

UFO:由微软开发的专注于Windows操作系统交互的UI代理

它可以通过理解用户的自然语言指令和屏幕的视觉内容,自动执行一系列复杂的任务。 比如“删除Word文档中的所有图片”或“在PowerPoint文稿中添加一个新幻灯片”。 它结合了GPT 4-V,能够理解和Windows应用程序的图形用户界面(GUI)并执行操作。 ...

视频生成模型“Sora”的5个弱点

虽然它是一个性能太高的模型,但也发布了一些失败输出

Base10 发布了新市场地图 – 和投资组合公司!

嵌入式软件平台是基础架构供应商,与专门的内部资源相比,它能让公司更快、更好、更轻松地启动多产品战略 来源:@Base10Partners

Sora视频:一只鲜花老虎飞升

OpenAI系统主管Connor Holmes @cmikeh2 发布 一只鲜花老虎飞升,又重新聚拢成老虎

Google发布了 Gemini-Pro-1.5

这是其 AI 模型的下一个版本,具有超过 1,000,000 个令牌上下文长度。 该模型现在可以一次性理解整本书、整部电影和播客系列。 这远远超过了所有其他竞争对手的聊天机器人上下文窗口。

OpenAI 和 Elon Musk \[译\]

OpenAI 的使命是确保全人类能从人工通用智能 (AGI) 中受益,这不仅意味着我们要构建既安全又有益的 AGI,也意味着我们要努力创造广泛分布的利益。现在,我们将分享我们如何实现这个使命的理解,以及我们与 Elon 的关系的一些事实。我们打算驳回 Elon 的所有主张

Vicarious :允许外科医生360度可视化和进入腹部的手术机器人

该机器人只需要1.5厘米的小切口来进行腹部手术,这比一枚硬币还小,大大减少了手术对患者身体的伤害和术后恢复时间。

OpenAI Sora的新文本到视频模型

Sora 是一个数据驱动的物理引擎。它是对许多世界的模拟,无论是真实的还是幻想的。模拟器通过一些去噪和梯度数学来学习复杂的渲染、“直观”物理、长期推理和语义基础。 如果 Sora 使用虚幻引擎 5 对大量合成数据进行训练,我不会感到惊讶。它必须如此!

NVIDIA发布一个可以运行在PC上本地模型:Chat With RTX

该模型可以与你自己的内容(文档、笔记、视频或其他数据)相连接, 利用检索增强生成(RAG)、TensorRT-LLM和RTX加速技术,用户可以个性化地创建一个聊天机器人。 快速获得上下文相关的答案。所有操作均在用户本地完成! 它专为搭载NVIDIA...