- Phi-2隻有2.7B參數

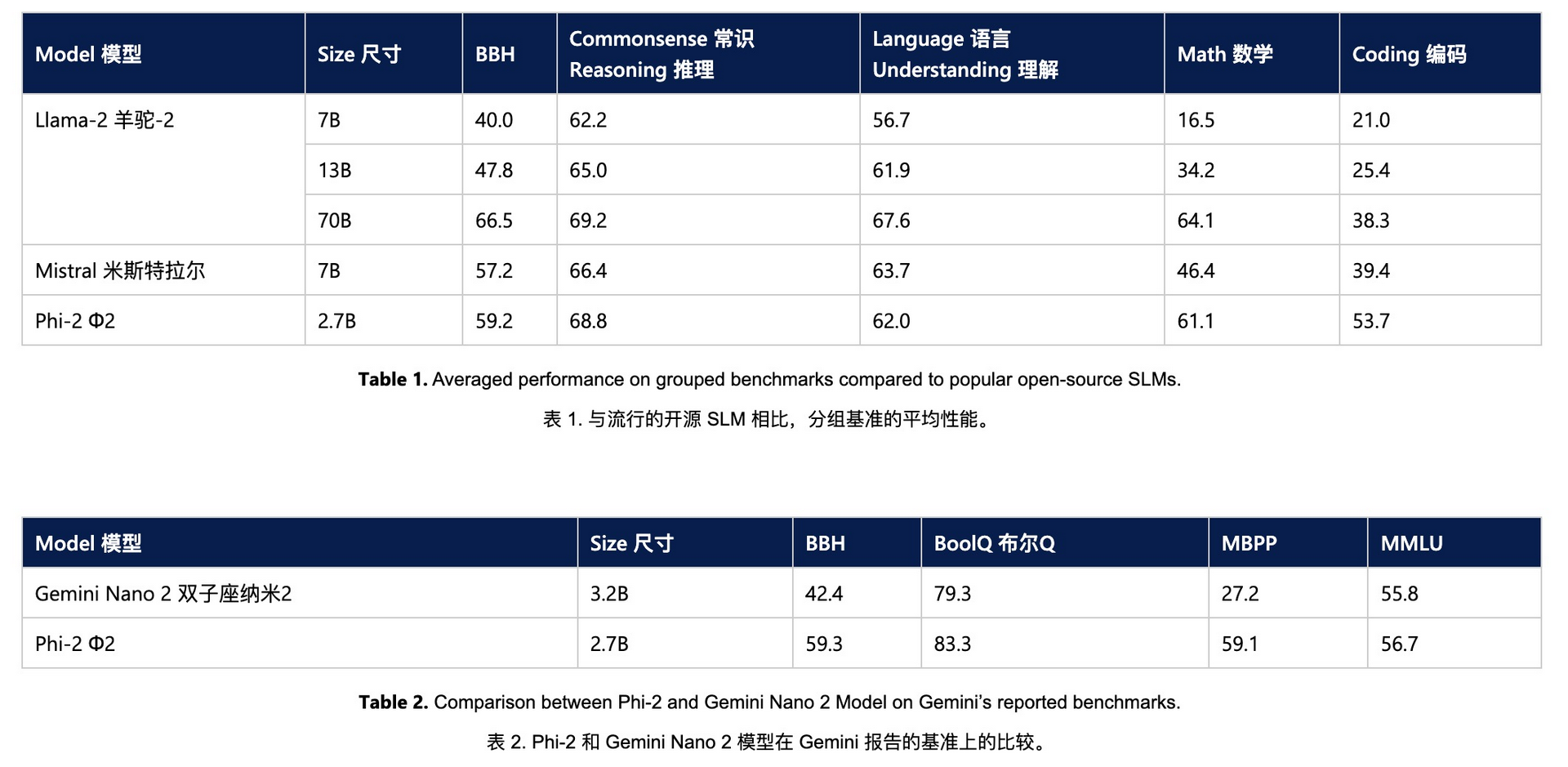

- Phi-2超越了Mistral和Llama-2型號,後者分別具有7 B和13 B參數

- 它甚至超越了Llama-2- 70 B模型,後者在多步推理任務中的參數數量是25倍

- 微軟表示,Phi-2的出色性能是由於其訓練數據質量非常高,而且他們擁有「教科書質量」的數據集

「教科書質量」數據集:為了訓練Phi-2,研究團隊創建了特定的數據集,專門用於教授模型常識推理和一般理解。這些合成數據集可能包含各種場景和問題,旨在提高模型處理現實世界問題的準確性和可靠性。

知識轉移:此外,研究團隊成功地將學到的知識和模式從較小的Phi-1.5模型轉移到較大的Phi-2模型。這不僅提高了Phi-2的學習效率,還加速了其訓練過程,使其能夠更快地達到高水平的性能。

詳情: https://microsoft.com/en-us/research/blog/phi-2-the-surprising-power-of-small-language-models/